- Veröffentlicht am

- • Politik

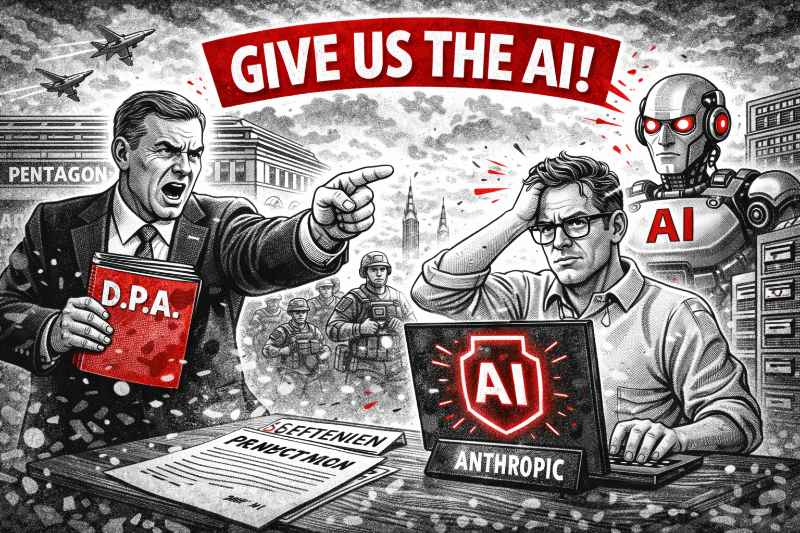

Pentagon vs. Chatbot: Wenn der Kalte Krieg ein Update bekommt

- Autor

-

-

- Benutzer

- tmueller

- Beiträge dieses Autors

- Beiträge dieses Autors

-

Früher bestellte das Pentagon Panzer. Heute bestellt es Prompts. Und wenn die Lieferung nicht schnell genug erfolgt, wird nicht mehr nur der Telefonhörer, sondern gleich ein Gesetz aus der Mottenkiste gezogen.

Zwischen dem US-Verteidigungsministerium und dem KI-Unternehmen Anthropic soll es derzeit zu einem Showdown gekommen sein, der klingt, als hätte jemand „Silicon Valley“ mit „Top Gun“ verwechselt. Laut Berichten wurde dem Unternehmen ein Ultimatum gestellt: uneingeschränkter Zugriff auf die eigene KI – oder es drohen Konsequenzen, die ungefähr so subtil sind wie ein Flugzeugträger im Hafen.

Die Drohkulisse ist bemerkenswert. Entweder Anthropic wird als Risiko für die nationale Lieferkette eingestuft – ein Label, das bislang eher geopolitischen Rivalen vorbehalten war – oder der legendäre Defense Production Act wird aktiviert. Ein Gesetz, das ursprünglich dazu gedacht war, in Krisenzeiten die Produktion von kriegswichtigen Gütern sicherzustellen. Panzer, Raketen, Masken in der Pandemie – und nun offenbar neuronale Netze.

Man kann sich die Szene bildlich vorstellen: Ein Offizier blättert durch ein staubiges Gesetzbuch und sagt: „Moment, hier steht doch was von nationaler Sicherheit. Das müsste doch auch für Algorithmen gelten.“

Anthropic hingegen gibt sich bislang erstaunlich unbeeindruckt. Das Unternehmen will seine Systeme weder für Massenüberwachung der eigenen Bevölkerung noch für autonome Waffen freigeben, die ohne menschliche Beteiligung feuern. In einer Zeit, in der „KI kann alles“ als Geschäftsmodell gilt, klingt diese Zurückhaltung fast rebellisch.

Das Pentagon sieht die Sache pragmatischer. Man brauche die Technologie. Und zwar jetzt. „Das Problem für diese Leute ist, dass sie so gut sind“, heißt es aus dem Ministerium. Es ist ein selten ehrliches Kompliment – mit eingebauter Drohung.

Der Widerspruch ist dabei fast poetisch: Das Verteidigungsministerium hat Anthropic im Sommer bis zu 200 Millionen Dollar für die Entwicklung agentischer KI-Arbeitsabläufe zugesagt. Man investiert großzügig, applaudiert öffentlich – und wenn es ernst wird, winkt man mit einem Zwangsgesetz.

Das ist in etwa so, als würde man einem Sternekoch einen Michelin-Stern verleihen und gleichzeitig ankündigen, seine Küche notfalls zu beschlagnahmen.

Die Einstufung als Lieferkettenrisiko hätte weitreichende Folgen. Andere Unternehmen müssten sich entscheiden: Geschäfte mit dem Militär – oder Geschäfte mit Anthropic. Ein moralisches Dilemma, das in der Praxis vermutlich sehr schnell zur betriebswirtschaftlichen Abwägung wird.

Und dann ist da noch die kleine Nebeninformation, dass Anthropics KI in bestehenden Pentagon-Systemen offenbar so tief integriert ist, dass sie nur mit erheblichem Aufwand entfernt werden könnte. Man droht also einem Partner, dessen Code bereits im eigenen Maschinenraum surrt.

Das Ganze wirft eine grundlegende Frage auf: Wem gehört die Zukunft? Dem Staat, der sie aus Sicherheitsgründen kontrollieren will? Oder den Unternehmen, die sie entwickeln und mit eigenen Leitlinien versehen?

Früher war die Rollenverteilung klar. Rüstungsunternehmen produzierten, der Staat bestellte. Heute sitzen die technologischen Schlüsselressourcen in Firmen, die auch Chatbots für den Alltag bauen. Die Grenze zwischen ziviler Innovation und militärischer Anwendung ist fließend – und manchmal nur eine Einstellung im Menü.

Der Defense Production Act war gedacht für Stahl, Treibstoff und Industrieanlagen. Dass er nun in einem Streit um KI-Grenzen diskutiert wird, zeigt, wie sehr sich Macht verschoben hat. Die wertvollsten Ressourcen sind keine Metalle mehr, sondern Modelle.

Anthropic steht nun vor einer Entscheidung, die größer ist als ein einzelner Vertrag. Nachgeben und interne Prinzipien relativieren? Oder standhaft bleiben und riskieren, vom Staat als strategisches Risiko eingestuft zu werden?

Das Pentagon wiederum muss entscheiden, wie weit es bereit ist zu gehen. Ein Gesetz aus dem Kalten Krieg auf Algorithmen anzuwenden, ist keine kleine Fußnote. Es ist ein Signal.

Vielleicht ist das der eigentliche Kern des Konflikts: KI ist längst keine Spielerei mehr. Sie ist geopolitische Infrastruktur. Wer sie kontrolliert, kontrolliert nicht nur Produktivität, sondern potenziell auch Verteidigungsfähigkeit.

Und so steht man in Washington plötzlich vor einer paradoxen Situation. Man braucht die klügsten Maschinen – aber nicht unbedingt deren ethische Bedienungsanleitung.

Während also irgendwo ein Serverrack leise rechnet, wird über Gesetze verhandelt, die älter sind als das Internet. Der Kalte Krieg hat ein Update bekommen. Und diesmal geht es nicht um Raketen, sondern um Rechenleistung.